La mayoría de los ciudadanos españoles considera que la inteligencia artificial potenciará y complementará el trabajo de las personas en vez de sustituirlas

La inteligencia artificial representa una innovación tecnológica radical y se ha convertido en la “tecnología definidora” o vector tecnológico más característico de nuestro tiempo, con efectos de muy amplia escala y profundidad, desde la economía y el trabajo hasta la educación, la información, la cultura, el entretenimiento, el transporte, la seguridad y el modo de ejercer sus funciones por parte de numerosos grupos profesionales, incluyendo a las profesiones del conocimiento más características como la práctica científica y la médica. Su rápida expansión y la profundidad potencial de sus impactos han situado a esta tecnología en el centro de atención de los medios y la opinión pública, las decisiones de las empresas y de los órganos reguladores, por las oportunidades que abre en términos de innovación, eficiencia, bienestar y empoderamiento cognitivo de individuos y organizaciones, pero también por las incertidumbres y dilemas éticos que plantea.

4 marzo, 2026

Desde el despegue de las tecnologías de la información ha venido operando una bifurcación de narrativas en marcado contraste acerca de su impacto y significado, que se ha agudizado de manera extrema con la irrupción de la inteligencia artificial generativa: por un lado, la expectativa de que puede aumentar o amplificar nuestras capacidades cognitivas en múltiples ámbitos; y por otro, el temor de que pueda sustituir y reemplazar al factor humano en áreas y funciones que tradicionalmente han estado protegidas de lo “mecanizable” o realizable por las máquinas y los algoritmos. Esta última narrativa presenta una variante, preocupada no solo por el impacto que puede tener esta tecnología disruptiva sobre el nivel de empleo, sino por el desafío cultural que implica para nuestra identidad como especie. La inteligencia –las capacidades cognitivas vinculadas al lenguaje, el análisis, el razonamiento abstracto, la creatividad y la conducta orientada a fines basada en el conocimiento y los valores– es el atributo distintivo que tradicionalmente ha servido para demarcar doblemente la identidad de la especie humana respecto a los animales y, también, respecto a las máquinas. El despegue de la IA generativa despierta inquietud ante la posibilidad de que las máquinas y sistemas basados en la IA no solo sean capaces de hacer lo mismo que los humanos en el plano cognitivo, sino que incluso nos superen y puedan llegar a actuar autónomamente.

En paralelo a esas dos visiones, en el debate público actual se observa una tensión entre, por un lado, una narrativa de “determinismo tecnológico”, según la cual la inteligencia artificial, una vez que se ha desarrollado y comenzado a aplicar, se impondrá en una esfera tras otra de la vida social como si fuera una fuerza incontrolable de la naturaleza, acarreando consecuencias inevitables ante las que los individuos y las sociedades apenas tendrían margen de actuación, más allá de adaptarse mejor o peor a sus consecuencias; y por otro, la visión de un desarrollo tecnológico modelado en medida significativa por los valores, las preferencias y las decisiones adoptadas por los agentes humanos, en las fases de diseño, construcción, despliegue, supervisión y control de las máquinas y sistemas inteligentes por el factor humano. Frente a la tesis del determinismo tecnológico, la historia del siglo XX evidencia que la sociedad, sin renunciar a los numerosos beneficios de tecnologías disruptoras, dispone de instrumentos para intervenir en su modelado a través de la regulación legislativa, la implementación de políticas públicas, los códigos éticos de empresas y desarrolladores, los valores y los usos de la ciudadanía, influyendo todas esas variables en la forma final que adoptan los avances tecnológicos y su proyección a la sociedad.

Atendiendo a este contexto de expectativas duales (de promesas y de reservas) ante la IA, la Fundación BBVA ha llevado a cabo un estudio de opinión pública sobre “Actitudes hacia la Inteligencia Artificial en España”, concebido como una “medición cero” o temprana de las actitudes y usos por la población de esta tecnología. Se ha medido así el nivel de comprensión de la IA, las expectativas, valoraciones y sentimientos que suscita la IA, tanto agregadamente como de una forma diferenciada en un amplio abanico de ámbitos y facetas de la esfera privada y de dominios de la vida pública. Se examina también el grado de adopción personal de las herramientas de IA para distintas finalidades en la vida cotidiana.

Alta visibilidad de la IA en la opinión pública (D.4-5) (*)

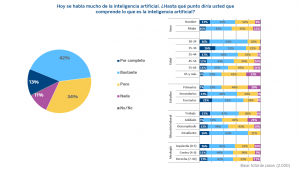

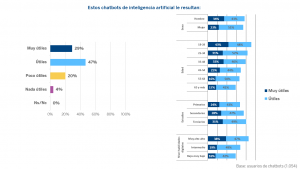

En un periodo inusualmente corto, la nueva generación de IA ha logrado saltar de los laboratorios a la opinión pública, alcanzando una cobertura intensa y sostenida por los medios, que se traduce en que ocho de cada diez individuos de 18 y más años hayan oído hablar de los chatbots como ChatGPT, Gemini o Copilot. Con todo, esa muy alta elevada visibilidad se traslada solo en parte a comprensión de qué es la inteligencia artificial, con un 55% que declara entender en qué consiste frente a un 45% que reconoce un débil (34%) o nulo (11%) nivel de comprensión. El nivel de comprensión más alto se observa entre los hombres, los grupos de menor edad de la muestra (18 a 44 años), los que trabajan o estudian y los que tienen un nivel más alto de estudios.

Más allá de saber en qué consisten los chatbots y, más en general, la IA, se ha alcanzado ya un uso notable de los mismos, con una partición de la población en dos grandes grupos, el de quienes los han usado, un 53%, frente a un 47% que declara no utilizarlos a comienzos de 2026 (aunque seguramente una parte de este segundo grupo usa algunos de sus desarrollos como los resúmenes de IA ofrecidos por los buscadores).

Primer eje de la percepción del público de la IA: sentimientos y predisposiciones emocionales (D.6-8)

La aparición de avances tecnológicos radicales, característicos de una época, presentes en los medios de comunicación, el cine, la literatura y la cultura popular, suscita sentimientos y predisposiciones emocionales, que van desde el entusiasmo a la preocupación, pasando por la indiferencia.

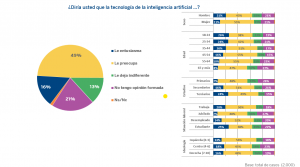

A comienzos de 2026, en la sociedad española predomina el sentimiento de preocupación respecto a la IA (un 49%), frente a un 16% al que le entusiasma, un 13% para el que es indiferente y un amplio grupo (21%) que no tiene aún una opinión formada. El nivel de familiaridad con la IA influye claramente sobre los sentimientos: quienes tienen un mayor nivel de comprensión de la IA y quienes han utilizado chatbots tienden a mostrar mayor entusiasmo y tener una opinión más definida, aunque prevalece en todos los grupos la preocupación.

Segundo eje de la percepción del público de la IA: expectativas sobre la IA (D.9-11)

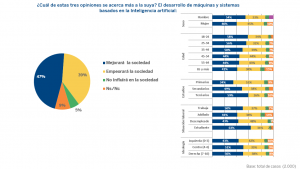

Las tecnologías y avances científicos emergentes sobre los que todavía no se dispone de experiencia o de efectos demostrados generan expectativas o predisposiciones con valencia positiva, negativa o neutra. Es lo que se ha llamado “imaginar el mañana” asociado a la tecnología. En el caso de la IA, en la sociedad española a comienzos del 2026 se da una partición con predominio de quienes creen que “el desarrollo de máquinas y sistemas basados en la IA mejorará la sociedad” (un 47%), frente a un 39% cree que “empeorará la sociedad”.

El conocimiento y el uso de la IA aparece asociado a las expectativas, con una actitud claramente más positiva entre quienes comprenden la tecnología (el 61% cree que mejorará la sociedad) y fuertes reservas entre quienes declaran no estar familiarizados con la IA (solo el 23% cree que la mejorará).

Las expectativas favorables se incrementan también entre quienes han utilizado en alguna ocasión chatbots de IA (el 58% cree que mejorará la sociedad), frente a quienes nunca los han usado (solo el 34% cree que la mejorará).

Desde una perspectiva sociodemográfica, las expectativas favorables se acentúan entre los hombres, los intervalos de menor edad, las personas con mayor nivel educativo y los estudiantes. Es mayor también entre quienes se identifican ideológicamente con el centro y la derecha que con la izquierda.

Dos narrativas acerca de la IA: amplificación o sustitución del factor humano (D.12-13)

Como ocurriera con el arranque de los computadores, hoy a propósito de la IA conviven dos visiones: la de su desarrollo y utilización para reemplazar al elemento humano en numerosos dominios y la de su diseño y despliegue para amplificar las capacidades de las personas que, aun interaccionando con las herramientas de la IA, permanecen en el bucle de desarrollo de tareas (lo que el inventor del ratón y del interface gráfico, Douglas Engelbart, calificó como augmentation).

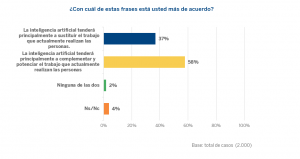

A principio del 2026, la mayoría de la población cree que, agregadamente, la IA tenderá principalmente a complementar y potenciar el trabajo que actualmente realizan las personas (un 58%) frente a un 37% que piensa que sustituirá el trabajo desarrollado por ellas.

La percepción de que la IA tenderá sobre todo a potenciar las capacidades humanas se acentúa entre quienes tienen estudios terciarios y entre los estudiantes. La visión opuesta, que la IA tenderá más bien a sustituir el trabajo de las personas, se acentúa según disminuye el nivel educativo y entre los desempleados.

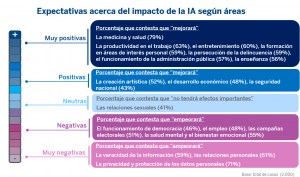

Imagen diferenciada de los impactos de la IA: dualismo según áreas de aplicación (D.14-16)

Aunque casi la mitad de la población declara que la IA es un fenómeno que le genera preocupación, cuando se pasa del plano agregado a la valoración de los impactos concretos, el diagnóstico se vuelve más matizado, configurando espacios duales, con valencias valorativas opuestas según áreas de aplicación.

La mayoría de la población reconoce el potencial de mejora asociada a la inteligencia artificial en áreas como la salud (79%), la productividad del trabajo (63%), el entretenimiento (60%) y la formación en áreas de interés personal (59%), la persecución de la delincuencia (59%), el funcionamiento de la administración pública (57%), la enseñanza (56%) y la creación artística (52%), mientras que expresan reservas acerca de sus efectos en la privacidad (un 71% cree que hará que empeore), las relaciones personales (empeorando para un 61%), la salud mental y bienestar emocional (para un 55%, empeorará), las campañas electorales y el funcionamiento de la democracia (para un 51% y un 46% respectivamente, empeorará), la veracidad de la información (empeorará para un 59%) y el empleo (empeorará para un 48%).

Respecto a un área objeto de atención en los medios y en el cine, el de las relaciones sexuales en las que intervenga la IA, la mayoría cree que no tendrá efectos importantes (un 41%) o que las empeorará (un 39%) y solo un modesto 7% cree que las mejorará.

Las expectativas sobre el impacto de la IA por área tienden a ser más favorables entre quienes se identifican con el centro y la derecha que entre quienes lo hacen con la izquierda. Las mayores diferencias entre los extremos ideológicos se observan en áreas como el funcionamiento de la democracia, la veracidad de la información, las campañas electorales, la privacidad y la protección de datos personales.

Percepciones de la ventaja comparativa del elemento humano frente a la IA autónoma (D.17)

En el escenario de un despliegue de aplicaciones de IA autónomas (no como asistentes o amplificadores del elemento humano), la percepción dominante es que en la mayoría de los trabajos y funciones que hasta ahora son características del elemento humano, la IA actuando autónomamente, lo hará peor. El área en la que la pauta se invierte es la de traducción de textos entre distintas lenguas, con una amplísima mayoría que considera que la IA lo hará mejor.

Actitudes ante diferentes usos de la IA (D.18)

En correspondencia con una valoración comparativa negativa de la IA autónoma respecto al elemento humano, predominan las reservas frente a escenarios en los que robots o aplicaciones de IA asuman funciones como el acompañamiento en problemas personales (media de 2,2, en una escala de 0 a 10, en la que 0 denota máxima incomodidad y 10 total comodidad), la atención al cliente por parte de una empresa privada (media de 2,8), la atención al ciudadano por aplicaciones de IA en la administración pública (2,7), la realización de diagnósticos médicos por IA (3,0) y la conducción autónoma de vehículos (3,0). La aplicación que genera menor incomodidad de entre las ofrecidas para valorar es la de intervenciones quirúrgicas (un 4,1), seguramente porque la gran mayoría conoce el uso de robots asistiendo en la cirugía llevada a cabo por profesionales médicos. La mayoría escoge las puntuaciones de máxima incomodidad (0-2 en una escala de 0 a 10).

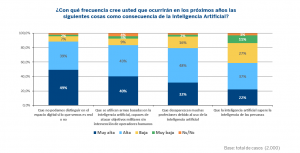

Efectos indeseados de la IA: incapacidad para distinguir la realidad, armas sin intervención humana, desaparición de profesiones y superación de la inteligencia humana (D. 19)

Amplias mayorías consideran que, como consecuencia del desarrollo de la IA, se producirán con una frecuencia “alta” o “muy alta” los siguientes efectos indeseados: el 88% afirma que que no se podrá distinguir en el espacio digital si lo que se ve es real o no; el 83% declara que se utilizarán armas capaces de atacar objetivos militares sin intervención de operadores humanos; el 80% considera que desaparecerán muchas profesiones; y el 59% cree que la IA superará la inteligencia de las personas.

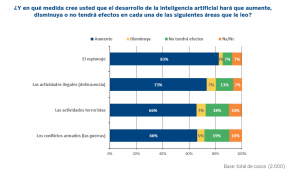

Efectos indeseados de la IA en áreas relacionadas con la seguridad: amplias mayorías temen el aumento del espionaje, la delincuencia, el terrorismo y las guerras (D. 20)

Entre los potenciales efectos indeseados derivados de la potencia y versatilidad de las herramientas de IA, que hoy ya están siendo objeto de debate e incluso de decisiones de uso restrictivo por parte de empresas líder de IA, destacan los relativos a áreas relacionadas con la seguridad. En ese ámbito, amplias mayorías temen que el desarrollo de esta tecnología provocará un aumento del espionaje (83%), la delincuencia (73%), el terrorismo (66%) y las guerras (66%).

Sentimiento de eficacia personal cognitiva y actitudes ante la IA (D.22-28)

El estudio revela diferencias nítidas entre el conjunto de la población, con más reservas o cautelas, y el subconjunto de ciudadanos que, en calidad de early adopters, son ya usuarios frecuentes de la IA –principalmente los jóvenes, el segmento con un nivel más alto de estudios y, de manera clara, entre quienes se autoperciben con un mayor grado de habilidades digitales–, con expectativas más positivas acerca de su impacto.

El uso de las aplicaciones de IA es muy variable entre la población, asociado claramente a la edad, los estudios y las habilidades digitales: las utilizan casi el 90% de los jóvenes frente al 20% entre los mayores de 65 años; el 72% de quienes tienen estudios terciarios frente al 30% entre los de nivel primario; y el 90% de quienes consideran que tienen un alto nivel de destreza digital frente al 16% de quienes se autoevalúan con un nivel muy bajo. También es algo mayor entre quienes se identifican con la derecha (el 58%) que con la izquierda (53%) o centro (51%).

El empoderamiento o sentimiento de eficacia personal de los usuarios activos de la IA está asociado a su mayor confortabilidad en el conjunto del espacio digital, permitiéndoles sentir mayor control sobre los desarrollos de la IA, convirtiéndose, al menos parcialmente, en actores en vez de sujetos pasivos y atenuando las reservas frente a sus potenciales efectos no queridos.

Si se hace zoom sobre los usuarios de los chatbots o aplicaciones de IA (el 53% de la población que los han utilizado en alguna ocasión), la visión sobre su utilidad es claramente positiva, entre muy útil y útil, para el 76%. Solo un cuarto de los usuarios efectivos los considera poco o nada útiles. Los usuarios con valoraciones más positivas son los jóvenes, con un mayor nivel de estudios y estudiantes y quienes declaran un nivel alto de destreza digital.

Entre los usuarios de la IA, la integración de esta tecnología se extiende al ámbito profesional, formativo y personal, constituyendo una herramienta de uso cotidiano para una proporción significativa de la población. El 69% ha utilizado estas aplicaciones en los últimos tres meses como apoyo para el aprendizaje o el estudio, el 65% para cuestiones personales y el 60% por motivos laborales.

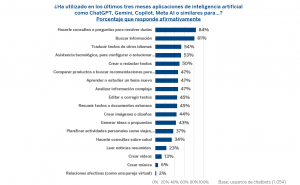

Los propósitos para los que se utilizan los chatbots o aplicaciones de IA son amplios y diversos, reflejando su versatilidad. Los más extendidos se vinculan con la búsqueda de información y la resolución de dudas (más del 80% afirma usarlos para estos propósitos). En un segundo plano, se sitúan las actividades orientadas al procesamiento y análisis de información —como las traducciones (54%), la redacción de textos (50%), la elaboración de resúmenes de documentos extensos (45%) y la edición y corrección de textos (45%)—, junto con aquellas relacionadas con el aprendizaje y estudio de temas nuevos (47%) y la generación de ideas o propuestas (43%). La proporción que declara utilizarlos para realizar consultas sobre salud (34%) es menor, más minoritario todavía es su uso para la creación de vídeos (13%) o música (6%), y solamente un 2% afirma utilizarlas para relaciones afectivas (como una pareja virtual).

El comportamiento de los usuarios de internet con respecto a los resúmenes de información facilitados por los buscadores basados en técnicas de inteligencia artificial es variable, pero refleja que la mayoría no se fía exclusivamente de los resultados ofrecidos por la IA: para un 40% depende del tipo de búsqueda, el 30% lee el resumen de la IA, pero revisa también los enlaces, y un 15% los ignora y revisa directamente los enlaces de los resultados de la búsqueda. Solo un 5% se queda únicamente con el resumen.

Ficha técnica

- Ámbito geográfico del estudio: España

- Universo: población general de 18 años y más.

- Método: encuesta telefónica.

- Tamaño y distribución de la muestra: una encuesta basada en una muestra de 2.000 casos. Distribución de la muestra aleatoria y con selección del individuo según cuotas de sexo y edad.

- Error de muestreo: el error muestral estimado con un nivel de confianza del 95.5% y en el caso más desfavorable (p=q=0,5) es de +/- 2,2.

- Fecha de realización del trabajo de campo: enero de 2026.

- El trabajo de campo ha sido coordinado y ejecutado por Imop Insight.

- El diseño del cuestionario y el análisis de los datos se han llevado a cabo por el Departamento de Estudios Sociales y Opinión Pública de la Fundación BBVA.

(*) Las referencias marcadas como D XX hacen mención a la diapositiva de la presentación en la que aparece el dato citado.